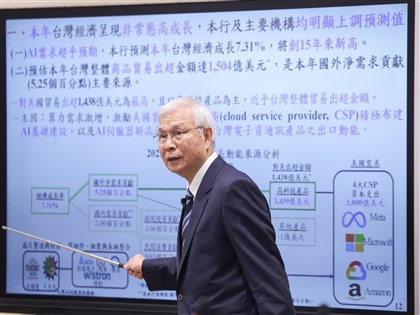

AI蓬勃大廠忙補倫理學分 微軟以人為本推準則

(中央社記者吳家豪台北8日電)人工智慧(AI)發展越來越快,衍生出的AI倫理議題也受到更多國際大廠關注。微軟在制訂AI倫理準則時,特別注重「以人為本」的思維,避免AI應用產生偏見。

早在2017年,Google旗下AI研究公司DeepMind就宣布成立專門研究小組,探討AI倫理問題。Facebook(臉書)去年初宣布將資助德國慕尼黑工業大學,成立獨立的人工智慧倫理研究所,為社會和經濟用途的相關技術制定負責任的道德準則。

在這波浪潮下,微軟內部也成立了AI倫理道德委員會,由產品開發、研究員、法務、人力資源等各部門負責人組成,共同制訂政策來指導微軟AI產品開發。

微軟大中華區人工智慧倫理委員會共同召集人施立成接受中央社記者採訪說,AI倫理在國外已經有蠻多討論,台灣政府和很多法律機構都在關注,科技部於去年9月也公布「人工智慧科研發展指引」,完善AI科技研發環境。

施立成強調,AI相關研究要注重資料,最重要的是大數據,但是在資料蒐集和分析處理的過程中,還是需要人的介入,不能只靠演算法。微軟內部訓練也是為了避免潛在性偏見,例如開發者的家庭因素可能導致潛意識存在偏見,需要避免在寫演算法的過程中受到影響。

為協助企業定義負責任的AI策略,微軟在官網提供的AI教戰手冊中提出6大準則,包括公平、可靠、隱私和安全、包容、透明、負責。

舉例來說,微軟認為AI系統應該公平對待所有人,採用多元化且具備代表性的數據和可分析的技術來偵測及消除偏見;這需要各個領域的專家在AI系統設計階段就一起合作,並且能對數據和分析模型進行系統化評估。

在「透明」準則方面,微軟認為當AI協助制訂會影響人類生活的決策時,應該確保人類了解這些決策的制訂過程,例如AI系統運作方式、如何與數據互動,可以更容易找出潛在偏見、錯誤和意外的結果。(編輯:楊凱翔)1090208

本網站之文字、圖片及影音,非經授權,不得轉載、公開播送或公開傳輸及利用。