解密歐盟人工智慧法案 KPMG:資料保護與 AI 倫理為台灣最需防守2大面向

(中央社訊息服務20240417 11:20:35)KPMG安侯建業今(17)日發布「解密歐盟人工智慧法案報告」。隨著人工智慧普及,各國政府已迫切需要制定防範措施和法律來應對重大新風險。就如同過往GDPR 法案對台灣產業影響深遠,在歐盟《人工智慧法案》的頒布後,臺灣企業需特別關注資料保護與 AI 倫理面向,作為跨國營運與產品開發的方針。

根據KPMG澳洲所和昆士蘭大學進行的一項全球調查《Trust in artificial intelligence》顯示,有五分之三的人對信任人工智慧系統保持謹慎態度,並且有71% 受訪者希望能對人工智慧能夠進行監管。

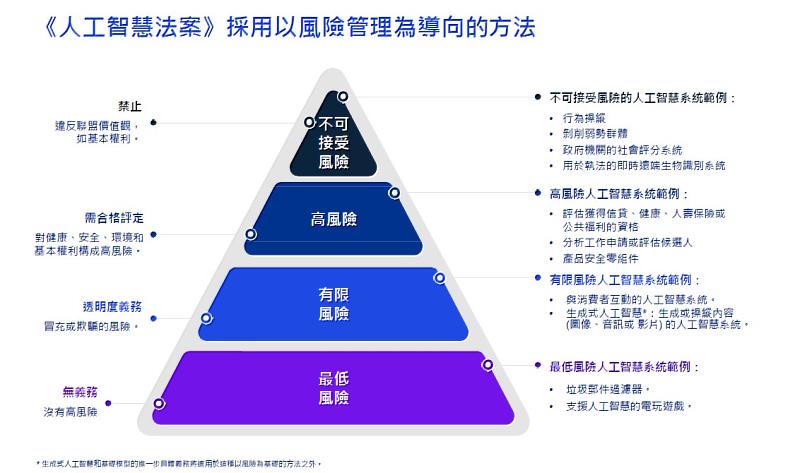

四大風險分層機制,嚴格規範人工智慧的使用道德性

《人工智慧法案》預計將於2024年立法,並有望從2025年開始實施,作為此領域中首見的法律,也預計會成為全球人工智慧監管實際的新標準。該法案定義了一個框架來理解人工智慧相關的風險,並根據它們獲得的資料以及利用該資料採取的決策或行動將它們分為四大類別:不可接受風險、高風險、有限風險、最低風險。

目的為管理或降低以下風險狀況:

• 禁止人工智慧系統中存在不可接受的風險。

• 避免侵犯基本權利。

• 防止使用影響潛意識或是不道德的技術,因為其可能會影響或扭曲個人行為,從而對該人或其他人造成傷害。

• 盡量減少可能導致不公平或不準確結果的偏見。

• 限制因年齡、殘疾、政治立場或其他因素而對弱勢群體或群體進行剝削。

規管範圍從供應商、開發經銷商甚至組織高階職位、合規相關單位與部署人員皆有其應負義務。企業不合規的後果則取決於違規的程度,範圍可能會從限制市場到巨額罰款,罰款則可能從3500萬歐元或全球營業額的7%,到750萬歐元或營業額的1.5%不等

該法案會對在歐盟境內提供人工智慧產品、服務或系統的任何企業產生立即廣泛的影響。此法案許多方面對組織來說都具有挑戰性,特別是在人工智慧應用程序的測試、透明度和可解釋性的技術文件方面。

台灣企業須注意,可以主動開始為合規做準備

KPMG安侯建業數位長賴偉晏表示,KPMG人工智慧帶來的變革力量前所未見,雖然潛力無窮但企業管理者仍要認清技術的本質是「為人所用」。只有當它與人類的專業知識、獨創性和有效的風險管理相結合時,才能充分發揮其潛力。

賴偉晏建議,對於台灣企業而言,從數據治理先開始著手,盤點清楚數據是否有被妥善的儲存、分析、利用才能真正解構 AI 模型的黑盒子,致力於提升模型的可信任度、可解釋度與確保倫理風險不會發生。

KPMG安侯企管顧問執行副總經理林大馗表示,這將讓台灣與歐盟的標準直接對接,以確保AI技術的開發和應用符合歐盟要求。同時,企業應把握機會,透過加強教育和培訓,提升專業人才在資料保護和AI合規性方面的知識和技能,也是目前產業迫切需要的。

隨著法規頒布時間在即,企業需確保組織中的合適人員儘快開始為這些即將到來的法規要求做準備,儘早瞭解需求及其對整個人工智慧生命周期的影響。第二步是全面瞭解組織中開發或使用的人工智慧系統,儘快制定明確的計劃,以管理必要的組織轉型,並確保在新的法律框架生效時及時遵守,以確保所有利害關係人與客戶的利益都能被保障,也才能真正讓企業的服務與品牌被深化與提升價值。